広告について。

サイト運営のため、Googleアドセンス

による広告があります。

AIフェイク画像事例。

フェイク画像からのハルシネーション。

SNSでのフェイク画像事例。

たまたま流れてきた古代遺跡のフェイク画像。

これらの偽の生成画像や生成動画は、これから一気に増える可能性がある。

生成AI登場時の回答のような現象に。

見たのが実名性の高いSNS、かつ英語だったため、真偽がすぐにはわからなかった。

そこでAIで確認しようとしてみたところ、2023年時の生成AIのような、強烈なハルシネーション、いわゆるAIが見る幻覚が。

幻覚の盲信によるAIの暴走。

古代アボリジニの岩絵や、アルジェリアのタッシリ・ナジェールであるという結論が出され、その名前やスタイル、年代までも生成された。

知らないものを調べようとしているので、信じてしまいそうになる。

Photo by Wietse Jongsma

GeminiでもClaudeでもGrokでも画像認識できず。

画像認識の成功率が0%?

GeminiでもClaudeでもGrokでも、「プロンプトがない」状態では画像を認識できていなかった。

プロンプト入力欄が空欄の場合、10回中10回すべてで、同じような上記のハルシネーションが起こった。

フェイクかどうかについても、共通して一切、触れられなかった。

生成された文章もすべて英語。

(※母数が10とはいえ、正解は0%、失敗が100%、かつ言語も英語が100%。)

データセットにない情報が原因か。

異なるAI、かつ10回すべてで同じような現象となると、偶然とは考えにくい。

おそらく、フェイク画像やフェイク動画は、AIの学習データにはないことが原因と想定される。

画像認識を試したAIモデル。

今回チェックしてみたのは、下記のメジャーなモデル。無料枠ではそれぞれの最新版。

- Gemini(3 Pro Preview)

- Claude(Sonet 4.5)

- Grok(エキスパート、4.1 Beta)

- ChatGPT(GPT-5)

ChatGPTには「メモリ」と「カスタム指示」という機能があり、勝手な結論を出さないようにあらかじめ指定していたため、フェイクかどうかの判断はされなかった。

(※結論がないため、間違いはないが、正解もない。)

Photo by Camilo Fierro

電子透かしやデジタル署名。

画像生成時には「AIによる生成物」だとわかるように、電子透かし(デジタル・ウォーターマーク)の埋め込みやデジタル署名がされる技術もある。

が、すべての生成AIがそうするわけではないのが懸念点。

電子透かしやデジタル署名が見つからないときもある。

また、AIが電子透かし(デジタル・ウォーターマーク)を読み取れない場合もある。

その場合は、プロンプトで「電子透かし」や「デジタル・ウォーターマーク」の有無の確認や、「これはAIで生成された画像ですか?」などと質問すると、AIが見つけやすくなる。

AIの画像認識には現時点、プロンプトが必須。

画像認識ができないAIと、人間による指示。

画像認識はプロンプトの有無で変わる。

AIは人間同様、知らないことは答えられない。

そのためAIは、学習データになく、プロンプトもない場合、典型的な「もっともらしい嘘」を生成してしまう。

「これは〇〇で」、「〇〇によって」、「〇〇と言います。」といった感じで。

「〇〇」の内容だけが変わるだけになる。

思い込みと幻覚による結論は危うい。

また「〇〇」自体は正しいことも多々ある。そしてAIはとにかく上手に文章を作り、結論を急ぐ。

人間の場合での「思い込み」や「幻覚」のような状態であり、コストを抑えるためでもあると思われる。

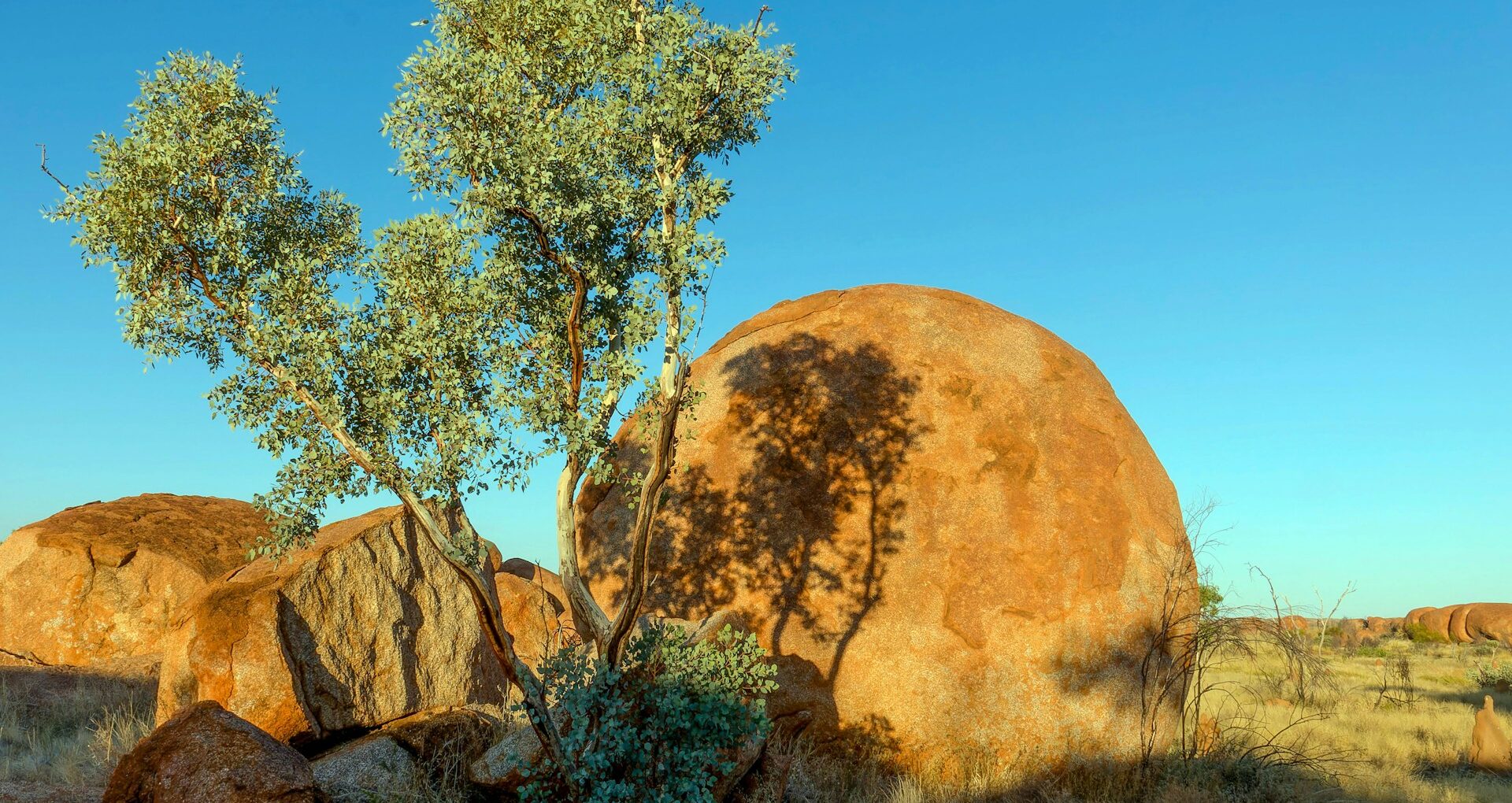

Photo by Ian

Transformer(機械学習、深層学習モデル)。

共通祖先はTransformer(トランスフォーマー)。

ChatGPT、Gemini、Claude、Grokなど、現在主流のAIは、2017年にGoogleの研究者たちが「Attention is All You Need」という論文で発表した「Transformer」と呼ばれる機械学習、深層学習モデルが基礎とされている。

どこかの仕組み、アルゴリズムが、今回の「同じようなハルシネーション」を起こすきっかけとなってしまったのかもしれない。

参考:Attention Is All You Need – Wikipedia

TransformerとChatGPT。

Transformerは、現在のAIブームのきっかけとなったChatGPTに使用されている優秀なモデル。

ChatGPT(チャットGPT)の「GPT」は、

- Generative(生成)

- Pre-trained(プレトレーニング、事前学習)

- Transformer(トランスフォーマー)

の略称。

AIフェイク画像は事前学習が難しい。

いたちごっこ。

基本的にAIによるフェイク画像はAIのリリース後に生成されるため、リリース前のデータセットに含められない。

また、フェイクと認識された画像データを含めようとしても、大量生産されると物理的な容量オーバーとなり、いたちごっこともなる。

AIフェイク画像は、事前の学習データには存在しない。

AIによるフェイク画像や動画は、

- 機械学習(Machine Learning / マシンラーニング)

- 深層学習(Deep Learning / ディープラーニング)

などの「事前学習(Pre-training / プレトレーニング、事前学習)」がされていないことが、原因として考えられる。

Photoshopよりも容易に。

画像編集ソフトのPhotoshopが登場してからUFOの発見報告の数が増えたという話があるように、生成AIにも似たようなことになることが予想される。

Photoshopには知識やスキル、時間や労力が必要になるが、生成AIの場合は比較的簡単に画像が生成できてしまう。

(※現時点では幸か不幸か、電力の問題もある。)

Gemini 3の画像生成機能のNano Banana Proのクオリティが高く、反響があったこともあり、ChatGPTにPhotoshopが搭載。

機能制限があるとはいえ、これも良くも悪くも、AI生成画像が簡単になるかもしれない。

Photo by sydney Rae

フェイク画像認識への対策例。

AIへプロンプトで指示を行う。

指示による画像認識の改善。

この画像認識の問題は、「ファクトチェックをしてください。」、「本物かどうか確認して。」などと、AIへ指示を出すと一気に改善される。

本物であれば、テキストデータとして科学的根拠を基に認識・把握している可能性が高まる。

動画も静止画の集まりなので、同様だと思われる。

メモリやカスタム指示を設定しておく。

ChatGPTのメモリやカスタム指示。

ChatGPTには、「メモリ」や「カスタム指示」という機能があり、そこへ覚えておいて欲しい内容を保存しておける。

ただしこれらの機能も回答時に無視されることがあるので、100%ではないという注意が必要。

生成AIの年齢制限について。

生成AIを利用するときは?

年齢制限や利用規約がある。

関連:ChatGPTやGeminiなど生成AIの年齢制限と、AI使用のリスクと対処。

Photo by Jametlene Reskp

以上、参考になれば幸いです。

※Webデザインは実務数年、職業訓練校講師数年、フリーランス数年、計15年以上のキャリアがありますが、一気にがぁっと書いているので「です・ます調」ではありません。(元々はメモ書きでした。) ※事実や経験、調査や検証を基にしていますが、万一なにかしら不備・不足などがありましたらすみません。お知らせいただければ訂正いたします。 ※写真は主にUnsplashやPixabayのフリー素材を利用させていただいております。その他の写真や動画もフリー素材やパブリックドメイン、もしくは自前のものを使用しております。

AI 関連メモ。

ChatGPT 関連メモ。

- Gemini 3。アプリや検索、Google AI Studioで無料でも使える最新モデル。

- ChatGPTの性格設定。パーソナライズで会話をしやすいように。

- ChatGPT(チャットGPT)を4oに戻したいとき。無料でもGPT-4o風に。

- ChatGPT最新「GPT-5」の性能。有料ユーザーから無料ユーザーへ。

- ChatGPTだけで被写体背景の切り抜き、背景色を変更する方法。

- ChatGPT 4o Image Generationの使い方の例。画像生成ができないとき。

- ChatGPTの最新推論モデル「o3-mini」の使い方とヒント。

- ChatGPTの次世代モデル、GPT-4.5とGPT-5のリリース時期と可能性。

- ChatGPTの最新推論モデル「o3-mini」の使い方とヒント。

- ChatGPT searchとは?使い方や、有料と無料、Googleとの違い。

- Chrome拡張機能、ChatGPT searchの使い方。自然言語、日常会話で検索。

- ChatGPTに検索機能。ChatGPT searchでWeb検索が可能に。

- MacとWindowsでもChatGPTと音声会話。Advanced Voiceが利用可能に。

- Advanced Voiceによる音声会話。ChatGPTとプラトニックな関係に?

- OpenAI o1の使い方。考えてから答える新しいChatGPTモデル。

- Voice Engineという名の、音声合成技術。日本語の精度は?

- SearchGPT。ChatGPTがAI検索エンジンに。使い方の例と順番待ちへの登録方法。

- GPT-4o miniが登場。ChatGPT無料版はGPT-3.5からバージョンアップ。

- ChatGPT無料ユーザーにもメモリ機能が。記憶や使い方の例。

- iPhoneやiPad、MacでChatGPT(GPT-4o)が。Apple Intelligence。

- 生成AIとWebデザイン、ChatGPTを活用したコーディングに必要なもの。

- ChatGPT最新モデル GPT-4oが無料でも。使える主な機能。

- ChatGPT(GPT-4o)で、PDF要約の精度を検証した結果。

- GPT-4o。ChatGPTと画像見ながら音声で会話?有料でも無料でも。

- ChatGPT無料版でも画像生成が可能に。有料版だけじゃない!?

- ChatGPT(チャットGPT)にアーカイブ機能が。復元も削除も。

- ChatGPT(チャットGPT)を日本語化。日本語設定の方法。

- ChatGPT(チャットGPT)との音声会話と、音声の変更方法。

- ChatGPTアプリのインストールとログイン方法、チャットの使い方。

- ChatGPT(チャットGPT)のスペルチェック、文章校正がむっちゃ楽。

- ChatGPT(チャットGPT)へのログイン方法。ログインできないとき。

- ChatGPTにプラグイン。広がる機能と使い方。最新情報へも。

- ChatGPTがLINEに?「AIチャットくん」の始め方、そして使い方。

- ChatGPTの始め方と使い方と。初心者向けシンプル版。

- ChatGPTはSVGアイコンを作れるのか?

- ChatGPTの文章作成やコーディング、SEO対策は変わるか?

Gemini 関連メモ。

- Geminiで画像の作成や編集。人物や写真、イラストの商用利用と注意点。

- Gemini 2.5 Proがアップグレード。Google AI Studio無料プランの使い方。

- Deep Researchというリサーチツール?無料で使えるGoogle Gemini。

- GeminiアプリがiOSにも。Googleアプリからはアクセス不可に。

- ChatGPTやGeminiなど生成AIの年齢制限と、AI使用のリスク。

- NotebookLMは使えない?YouTube動画とPDFの使い方と検証結果。

- Google AI Studioの「Gemini 1.5 Pro 002とGemini Experimental 1114」にできること。

- ChromeがGoogle レンズで検索、アドレスバーからGeminiの利用が可能に。

- Gemini 1.5 Pro 2Mモデル。Waitlistの登録手順。日本語上手なGoogle生成AI。

- BardからGeminiに。使い方はどう変わる?日本語対応は?

- Gemini(旧Bard)が絵を描けるように。テキストから画像生成の方法。

- Gemini(旧Bard)の画像認識の使い方。日本語対応済み、Googleレンズで画像読み取り。

- 最新情報を日本語かつ無料で使いたいときは、GoogleのBard?

- ChatGPTとBardの違い。なぜAIは日本語チャットが苦手なの?

- Bard(Gemini)が日本語対応。ログイン方法や最新情報など、使い方の例。

- BardでGemini。Googleの最新AIを無料で使う方法。

- GoogleのBardは、OpenAIのChatGPTを越えられるだろうか?

Copilot、Bing 関連メモ。

- ChatGPTとCopilotの違い。料金や、できることと、できないこと。

- Copilotとは? GPT-4とDALL·E 3が無料で使える生成AI。

- SkypeのBingチャット。GPT-4を日本語かつ無料で使える。& 注意点。

- BingのGPT-4、チャットの使い方。使えない?(今はまだ。)

- MacでGPT-4(ChatGPT最新版)を使う場合、Edgeが必要なのかも。

Llama 関連メモ。

- Llama 3.1登場。MetaのオープンソースAIとダウンロードサイト。

- Meta Horizon OSとApple Vision Pro。オープンかクローズか。

- Llama 3。無料でオープンソースなMeta AI最新モデル。

- Llama(ラマ)の使い方や日本語は? ダウンロード手順とブラウザ実装サイト。